Contents

Jak etyka kształtuje przyszłość rozwoju sztucznej inteligencji w Polsce?

Contents

Jak etyka kształtuje przyszłość rozwoju sztucznej inteligencji w Polsce?

Jak etyka kształtuje przyszłość rozwoju sztucznej inteligencji w Polsce?

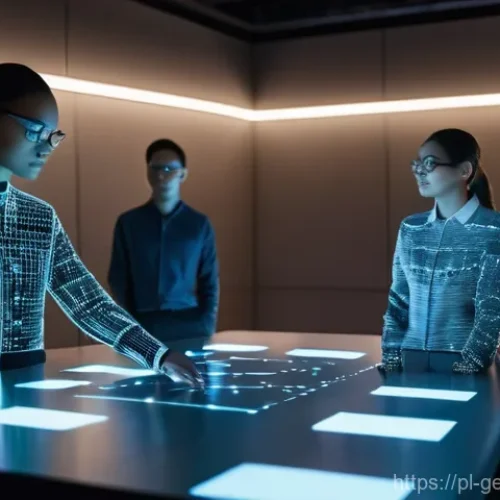

W dobie dynamicznego rozwoju sztucznej inteligencji w Polsce coraz częściej pojawia się pytanie o rolę …

5 zaskakujących sposobów na odkrywanie granic kreatywności między AI a człowiekiem

W erze dynamicznego rozwoju sztucznej inteligencji coraz częściej zastanawiamy się, gdzie przebiega granica między kreatywnością …

5 sposobów na rozpoznanie i przeciwdziałanie dyskryminacji w technologii AI

W erze dynamicznego rozwoju sztucznej inteligencji coraz częściej pojawiają się pytania o jej wpływ na …

Tajemnice certyfikacji etycznej AI: Jak zagwarantować zaufanie i innowacje?

Witajcie moi drodzy! Ostatnio, kiedy przeglądałam najnowsze doniesienia ze świata technologii, uderzyła mnie jedna myśl, …

Odkryj 5 Zaskakujących Prawd o Etycznej Odpowiedzialności Deweloperów AI

Świat pędzi do przodu, a wraz z nim sztuczna inteligencja, która jeszcze niedawno wydawała się …

Jak etyka kształtuje przyszłość rozwoju sztucznej inteligencji w Polsce?

W dobie dynamicznego rozwoju sztucznej inteligencji w Polsce coraz częściej pojawia się pytanie o rolę …

5 zaskakujących sposobów na odkrywanie granic kreatywności między AI a człowiekiem

W erze dynamicznego rozwoju sztucznej inteligencji coraz częściej zastanawiamy się, gdzie przebiega granica między kreatywnością …